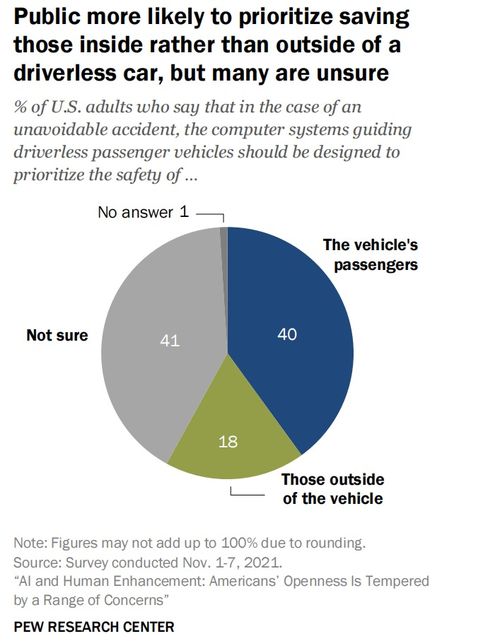

皮尤研究中心(Pew Research Center)發(fā)布了一份關(guān)于美國(guó)民眾對(duì)人工智能(AI)應(yīng)用態(tài)度的深度調(diào)研報(bào)告。這份報(bào)告不僅揭示了公眾對(duì)AI技術(shù)在不同領(lǐng)域應(yīng)用的復(fù)雜情感與擔(dān)憂(yōu),也為從事人工智能應(yīng)用軟件開(kāi)發(fā)的從業(yè)者、政策制定者及企業(yè)提供了至關(guān)重要的公眾視角與治理線(xiàn)索。

一、 調(diào)研核心發(fā)現(xiàn):謹(jǐn)慎的樂(lè)觀與深刻的擔(dān)憂(yōu)并存

報(bào)告顯示,美國(guó)公眾對(duì)AI的態(tài)度并非鐵板一塊,而是呈現(xiàn)出高度情境化的特征。在醫(yī)療健康(如輔助診斷)、科學(xué)研究等關(guān)乎公共福祉的領(lǐng)域,民眾表現(xiàn)出相對(duì)較高的接受度與期待,認(rèn)為AI有望帶來(lái)突破性進(jìn)步。在涉及個(gè)人隱私、就業(yè)安全、執(zhí)法監(jiān)控及社交媒體內(nèi)容推薦等領(lǐng)域,擔(dān)憂(yōu)情緒則顯著上升。民眾普遍擔(dān)心AI可能導(dǎo)致個(gè)人數(shù)據(jù)濫用、加劇社會(huì)不平等、替代人類(lèi)工作崗位,并在關(guān)鍵決策中缺乏透明度和問(wèn)責(zé)機(jī)制。

這種“領(lǐng)域特異性”的態(tài)度表明,公眾并非籠統(tǒng)地拒絕或擁抱AI,而是基于其應(yīng)用場(chǎng)景、潛在風(fēng)險(xiǎn)與收益進(jìn)行審慎評(píng)估。這對(duì)開(kāi)發(fā)者而言是一個(gè)明確信號(hào):技術(shù)的接受度與其社會(huì)影響的感知直接相關(guān)。

二、 對(duì)人工智能應(yīng)用軟件開(kāi)發(fā)的直接啟示

- 以?xún)r(jià)值為導(dǎo)向的設(shè)計(jì):軟件開(kāi)發(fā)不應(yīng)僅僅追求技術(shù)的新穎性或功能的強(qiáng)大,而應(yīng)從一開(kāi)始就將社會(huì)價(jià)值、倫理考量與用戶(hù)體驗(yàn)置于核心。例如,在開(kāi)發(fā)用于招聘、信貸評(píng)估的AI系統(tǒng)時(shí),必須將公平性、可解釋性和偏見(jiàn)緩解機(jī)制內(nèi)嵌于算法模型與產(chǎn)品設(shè)計(jì)中。

- 透明化與用戶(hù)賦權(quán):報(bào)告凸顯了公眾對(duì)“黑箱”操作的不信任。因此,應(yīng)用軟件需要提供清晰的界面,告知用戶(hù)AI何時(shí)被使用、基于哪些數(shù)據(jù)、做出了何種推斷或建議,并盡可能以通俗語(yǔ)言解釋其工作原理。應(yīng)賦予用戶(hù)選擇權(quán)和控制權(quán),例如允許用戶(hù)調(diào)整個(gè)性化推薦的參數(shù),或選擇退出某些基于AI的數(shù)據(jù)分析。

- 隱私保護(hù)的前置化:鑒于對(duì)數(shù)據(jù)濫用的深切擔(dān)憂(yōu),開(kāi)發(fā)者在數(shù)據(jù)收集、存儲(chǔ)、處理和使用等各個(gè)環(huán)節(jié),都必須遵循“隱私設(shè)計(jì)”原則。這意味著需要采用數(shù)據(jù)最小化、匿名化、加密等先進(jìn)技術(shù),并在隱私政策中進(jìn)行清晰、誠(chéng)實(shí)的溝通,而非事后補(bǔ)救。

- 聚焦增強(qiáng)而非替代:在容易引發(fā)就業(yè)焦慮的領(lǐng)域,如客戶(hù)服務(wù)、內(nèi)容創(chuàng)作等,AI應(yīng)用的設(shè)計(jì)思路應(yīng)強(qiáng)調(diào)“增強(qiáng)人類(lèi)能力”,即作為工具輔助人類(lèi)提高效率與創(chuàng)造力,而非完全取代人的角色。這有助于緩解社會(huì)阻力,并創(chuàng)造更可持續(xù)的人機(jī)協(xié)作模式。

三、 指向更廣泛的人工智能治理

公眾的態(tài)度是構(gòu)建有效AI治理框架的基石。報(bào)告中的擔(dān)憂(yōu)直接指向了當(dāng)前治理的短板:

- 需要健全的法律法規(guī):公眾期待明確的規(guī)則來(lái)約束AI的研發(fā)與應(yīng)用,特別是在高風(fēng)險(xiǎn)領(lǐng)域。這要求政策制定者加快步伐,出臺(tái)關(guān)于算法審計(jì)、責(zé)任認(rèn)定、數(shù)據(jù)權(quán)利等方面的法律。

- 推動(dòng)多方參與的治理模式:AI治理不能僅靠政府或科技公司。報(bào)告暗示了建立包括技術(shù)專(zhuān)家、倫理學(xué)家、社會(huì)科學(xué)家、公眾代表及行業(yè)組織在內(nèi)的多元協(xié)同治理機(jī)制的必要性,以確保各方視角與利益得到平衡。

- 加強(qiáng)公眾教育與溝通:許多擔(dān)憂(yōu)源于對(duì)AI技術(shù)的不了解。開(kāi)發(fā)者、企業(yè)和研究機(jī)構(gòu)有責(zé)任開(kāi)展公眾科普,用事實(shí)減少誤解,同時(shí)坦誠(chéng)討論技術(shù)的局限性與風(fēng)險(xiǎn),共同塑造負(fù)責(zé)任的創(chuàng)新文化。

結(jié)論

皮尤的調(diào)研報(bào)告如同一面鏡子,映照出社會(huì)對(duì)AI革命既期待又不安的復(fù)雜心態(tài)。對(duì)于人工智能應(yīng)用軟件開(kāi)發(fā)者而言,這絕非遙遠(yuǎn)的背景噪音,而是產(chǎn)品能否獲得長(zhǎng)期社會(huì)認(rèn)可和市場(chǎng)成功的關(guān)鍵輸入。成功的AI應(yīng)用,必然是那些在追求技術(shù)進(jìn)步的能積極回應(yīng)公眾核心關(guān)切、將倫理與治理內(nèi)化于設(shè)計(jì)之中、致力于解決真實(shí)問(wèn)題并為社會(huì)創(chuàng)造普惠價(jià)值的產(chǎn)物。未來(lái)的競(jìng)爭(zhēng),不僅是算法與算力的競(jìng)爭(zhēng),更是信任與責(zé)任的競(jìng)爭(zhēng)。